江蘇眼動追蹤是科學精神嗎

眼動追蹤技術正在成為L4級自動駕駛系統的“視覺中樞”。華弘智谷的DMS(駕駛員監測系統)集成多模態傳感器,通過紅外攝像頭捕捉瞳孔變化,結合方向盤握力數據構建注意力疲勞模型。在比亞迪漢EV的實測中,該系統可提前15秒預警分心行為,誤報率低于0.3%。更突破性的是,其眼動算法能識別駕駛員對道路標志的注視順序,當系統檢測到用戶忽略限速標識時,會通過AR-HUD疊加動態警示框。此外,華弘智谷與蔚來汽車合作開發的“視線接力”功能,在自動駕駛切換人工駕駛時,通過眼動軌跡預測駕駛員意圖,提前0.5秒啟動車輛控制權交接,***降低模式切換風險。目前,該技術已通過ISO 26022標準認證,成為國內較早獲車規級認證的眼動追蹤方案。眼動追蹤通過記錄眼球運動軌跡,精確量化用戶對視覺刺激的注意力分配。江蘇眼動追蹤是科學精神嗎

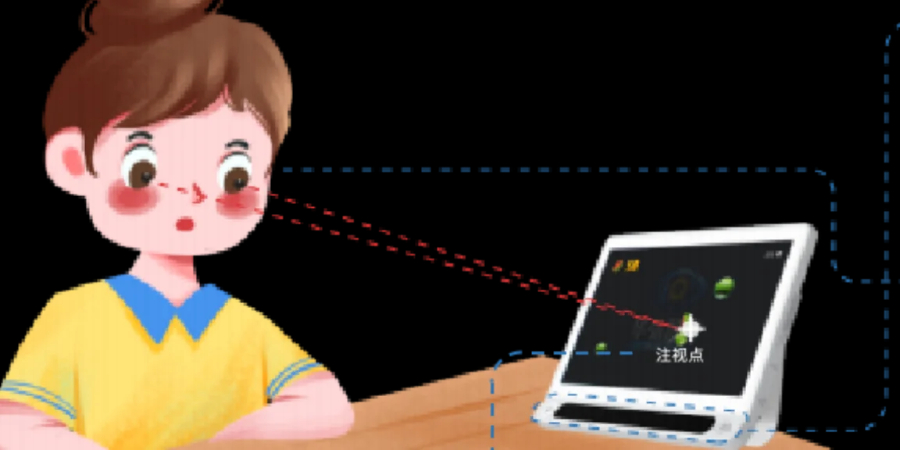

眼動追蹤技術在教育領域的創新在現代教育課堂上,眼動追蹤技術正在改變傳統的教學模式。教師通過眼動追蹤設備實時觀察學生在閱讀教材或觀看教學視頻時的眼動軌跡,了解學生對知識點的關注程度和理解難度。例如,當學生在某個概念的解釋部分停留時間過長時,教師可以及時調整教學策略,進行更詳細的講解。同時,眼動追蹤技術還可以用于開發個性化的學習系統,根據學生的眼動數據推薦適合的學習內容和學習路徑,讓每個學生都能在**適合自己的節奏下學習。江蘇眼動追蹤 ppt某些智能手機搭載了眼動追蹤技術。

作為眼動追蹤領域的隱形***,華弘智谷持續突破技術邊界。其***研發的“全息眼動模組”采用光場成像技術,在無需佩戴設備的情況下實現0.5°精度追蹤,已應用于華為Vision Pro的原型機測試。在算法層面,公司提出的“動態閾值自適應模型”將眼動數據噪聲降低70%,使在強光或暗光環境下的識別率穩定在98%以上。在全球化布局方面,華弘智谷在德國慕尼黑設立歐洲研發中心,專注汽車級眼動技術;在美國硅谷建立AI實驗室,探索眼動與腦電的融合感知;在東南亞組建本地化團隊,推動教育、醫療等場景的應用落地。截至2024年Q2,公司已擁有眼動追蹤相關**327項,其中PCT國際專利占比達41%,技術輸出覆蓋全球15個國家和地區。

2024 年 6 月深圳第五屆 AR/VR 產業論壇上,華弘智谷副總經理梁立偉在主題演講中***披露,公司已完成“虹膜+眼動”雙引擎的 XR 標準化模組量產,單目重量降至 3.2 g,采樣延遲控制在 5 ms 以內,可直接嵌入國產 AR 眼鏡鏡腿,實現注視點渲染與身份認證一次性完成,引發多家終端廠商現場簽約;論壇結束后,該模組被多家媒體評為“2024 年度 XR 交互突破技術”2024 年 10 月,華弘智谷攜 ZG-Med 醫療眼動系統在“第二十六屆全國眼科學術大會”亮相,現場演示了針對嬰幼兒的“無標定注視偏好”范式:設備利用虹膜特征作為空間錨點,30 秒完成 6 個月大嬰兒的***眼動校準,并實時輸出視敏度曲線,中山眼科醫院當場宣布將該系統納入新生兒篩查路徑,預計每年可服務 8 萬名早產兒,相關報道被《中國眼科網》連續三天置頂眼動追蹤技術可揭示用戶瀏覽網頁時的視覺路徑。

眼動追蹤技術為博物館展陳設計提供了科學依據。華弘智谷與故宮博物院合作的“數字文物眼動研究”項目,通過可穿戴眼動儀記錄觀眾參觀路線和凝視熱點。數據分析顯示,觀眾在《千里江山圖》前的平均凝視時間為47秒,其中72%的注視點集中在青綠山水區域,而題跋部分的注視時長不足8秒。基于此,故宮在復刻展中采用動態燈光引導,將觀眾注意力向題跋區域延伸,使該區域注視時長提升至15秒。此外,眼動數據還揭示了不同文化背景觀眾的觀展差異——歐美觀眾更關注文物細節紋理,而亞洲觀眾傾向于整體構圖欣賞。這些發現已應用于敦煌研究院的虛擬展廳設計,通過眼動追蹤優化3D模型渲染重點,使海外觀眾滿意度提升31%。在AR/VR設備中,眼動追蹤技術使“所見即所選”成為現實,用戶需凝視虛擬按鈕即可觸發操作。上海自制眼動追蹤

眼動追蹤助力優化教學內容。江蘇眼動追蹤是科學精神嗎

國內***把虹膜識別、眼動追蹤與門禁閘機三合一的產品,采用米到米可變高度相機滑軌,滿足兒童、輪椅用戶到普通成人的全身高覆蓋。閘機頂部集成200Hz雙目眼動模組,當人員靠近米時即啟動“視線喚醒”——用戶只需注視閘機屏幕秒即可完成虹膜比對與開閘,全程無接觸,杜絕指紋或人臉口罩遮擋帶來的失敗率。系統內置***檢測算法,可抵御高清照片、3D面具及打印虹膜的欺騙攻擊;誤識率<10??,拒識率<1%。2024年7月,ZG-Access已部署于深圳寶安機場T3航站樓員工通道,日均通行萬人次,平均通關時間秒,較傳統刷卡方式效率提升400%,并獲民航局“無接觸智慧通行”示范工程認證。復制分享。 江蘇眼動追蹤是科學精神嗎

- 浙江三星虹膜識別好用嗎 2025-09-17

- 江西眼動追蹤場景照片 2025-09-17

- 貴州眼動追蹤涉及到的知識 2025-09-17

- 河北眼動追蹤公式 2025-09-17

- 江西眼動追蹤圖片 2025-09-17

- 安徽vivo眼動追蹤 2025-09-17

- 浙江無法使用虹膜識別 2025-09-16

- 陜西虹膜識別門鎖 2025-09-16

- 江蘇lumia虹膜識別 2025-09-16

- 四川lg虹膜識別 2025-09-16

- 清遠停車場車庫道閘專業生產商 2025-09-17

- 進口感煙探測器價格 2025-09-17

- 湖北哪款源代碼加密 2025-09-17

- 中國臺灣源代碼加密口碑 2025-09-17

- 全高閘校園系統廠家 2025-09-17

- 上海弱電工程服務費 2025-09-17

- 四川門禁分時主機報價 2025-09-17

- 濱江區老舊廠房消防施工改造團隊 2025-09-17

- 靜安區國內大模型智能客服銷售廠 2025-09-17

- 達州景區智能道閘價格多少 2025-09-17